生成式人工智能 定義、挑戰(zhàn)與公共數(shù)據(jù)治理的必要性

生成式人工智能是指能夠自主創(chuàng)建全新內(nèi)容的人工智能系統(tǒng),如文本、圖像、音頻或代碼等。其核心在于通過分析海量數(shù)據(jù),學(xué)習(xí)數(shù)據(jù)的內(nèi)在規(guī)律與模式,進(jìn)而生成具有高度原創(chuàng)性和連貫性的新內(nèi)容。以ChatGPT、Midjourney等為代表的生成式AI應(yīng)用迅速崛起,展現(xiàn)出巨大的創(chuàng)造潛力與社會(huì)經(jīng)濟(jì)價(jià)值。

生成式AI的快速發(fā)展也帶來了一系列嚴(yán)峻挑戰(zhàn),尤其是在數(shù)據(jù)利用層面。這些挑戰(zhàn)凸顯了對(duì)生成式人工智能進(jìn)行規(guī)范,特別是對(duì)其所使用的公共數(shù)據(jù)進(jìn)行治理的緊迫性。專家分析指出,規(guī)范的必要性主要體現(xiàn)在以下幾個(gè)方面:

數(shù)據(jù)來源與版權(quán)問題。生成式AI的訓(xùn)練依賴于海量數(shù)據(jù),其中不可避免地包含了大量受版權(quán)保護(hù)的公共或私人內(nèi)容。未經(jīng)明確授權(quán)地抓取和使用這些數(shù)據(jù),可能引發(fā)嚴(yán)重的知識(shí)產(chǎn)權(quán)糾紛,并削弱原創(chuàng)者的創(chuàng)作積極性。

數(shù)據(jù)偏見與公平性。如果訓(xùn)練數(shù)據(jù)本身存在偏見或不平衡(例如,在某些人群或文化上代表性不足),生成的AI內(nèi)容將放大并固化這些偏見,導(dǎo)致歧視性輸出,損害社會(huì)公平與包容。規(guī)范數(shù)據(jù)采集和處理流程,是確保AI公平、中立的基礎(chǔ)。

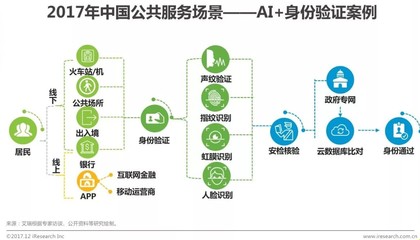

第三,隱私與安全風(fēng)險(xiǎn)。公共數(shù)據(jù)中可能包含個(gè)人敏感信息。不加規(guī)制的數(shù)據(jù)采集與使用,可能導(dǎo)致個(gè)人隱私泄露,甚至被用于制造深度偽造內(nèi)容進(jìn)行欺詐或誹謗,對(duì)社會(huì)信任和個(gè)體安全構(gòu)成威脅。

第四,內(nèi)容真實(shí)性與信息生態(tài)。生成式AI可以輕易制造出以假亂真的文本、圖片和視頻,這加劇了虛假信息和深度偽造的傳播風(fēng)險(xiǎn),擾亂公共信息環(huán)境,侵蝕公眾對(duì)事實(shí)的認(rèn)知基礎(chǔ),對(duì)社會(huì)治理構(gòu)成挑戰(zhàn)。

第五,責(zé)任歸屬與透明度。當(dāng)AI生成的內(nèi)容造成損害時(shí),責(zé)任應(yīng)如何界定?其決策過程如同“黑箱”,缺乏透明度。規(guī)范要求提高AI系統(tǒng)的可解釋性和透明度,并建立清晰的責(zé)任追溯機(jī)制,是保障問責(zé)制落實(shí)的關(guān)鍵。

因此,對(duì)生成式人工智能的規(guī)范,尤其是對(duì)作為其“養(yǎng)料”的公共數(shù)據(jù)進(jìn)行有效治理,并非限制創(chuàng)新,而是為了引導(dǎo)其健康發(fā)展。專家建議,規(guī)范的路徑應(yīng)包括:建立清晰的數(shù)據(jù)采集與使用授權(quán)框架;制定數(shù)據(jù)標(biāo)注與去偏見的行業(yè)標(biāo)準(zhǔn);強(qiáng)化隱私保護(hù)技術(shù)(如聯(lián)邦學(xué)習(xí)、差分隱私)的應(yīng)用;推行生成內(nèi)容的來源標(biāo)識(shí)與可追溯技術(shù);以及構(gòu)建跨學(xué)科、跨領(lǐng)域的協(xié)同治理體系。

規(guī)范生成式人工智能,核心在于規(guī)范其數(shù)據(jù)根基。通過構(gòu)建一個(gè)安全、公平、透明且負(fù)責(zé)任的公共數(shù)據(jù)利用生態(tài),我們才能在充分釋放AI創(chuàng)新潛力的有效管控風(fēng)險(xiǎn),確保這項(xiàng)顛覆性技術(shù)最終服務(wù)于人類社會(huì)整體的福祉與進(jìn)步。

如若轉(zhuǎn)載,請(qǐng)注明出處:http://www.lqoblqj.cn/product/6.html

更新時(shí)間:2026-04-07 17:31:12